В НовГУ создают модели ИИ для управления компьютером с помощью глаз

05 июня 2025, 16:13 1361

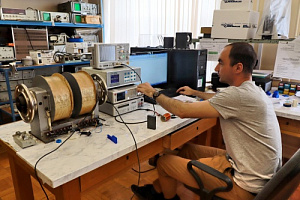

Студенты Политехнического института НовГУ Артём Алексеев и Валентин Баранов разработали модели искусственного интеллекта, определяющие на фотографиях рамки лиц и их ключевые точки. В будущем учёные НовГУ планируют использовать эту модель при работе над айтрекером — устройством, которое отслеживает движения глаз и позволяет управлять компьютером при помощи взгляда. Это особенно актуально для людей с ограниченными возможностями здоровья, которые из-за своего состояния не могут пользоваться мышью.

Первая модель, созданная студентами, умеет определять рамку лица. Вторая — ключевые точки: глаза, брови, нос, рот. Модели образуют своеобразную нейросетевую систему: она распознаёт лица, обрезает эти фрагменты на фото, считывает биометрические показатели. Датасет для обучения нейросети взяли из открытых источников, отредактировали и дополнили. После обучения искусственный интеллект прошёл тестирование на закрытом датасете, к которому у разработчиков не было доступа. При распознавании рамки лица наложение площадей составило 87%. Модель распознавания ключевых точек показала отклонение менее чем в два пикселя при изображении в 96х96 пикселей.

Наставник студенческой команды — ассистент кафедры информационных технологий и систем НовГУ Игорь Кулаков. Он изучает айтрекинг и планирует в ближайшей перспективе приступить к разработке такого устройства. Уже в следующем семестре начнётся сборка нового датасета для обучения третьей модели для данной системы. В начале 2026 года планируется уже иметь прототип программного обеспечения.

Модели, созданные Артёмом Алексеевым и Валентином Барановым, будут использоваться в работе.

— Наша гипотеза в том, что трёх моделей машинного обучения будет достаточно для работы системы айтрекера, — пояснил Игорь Кулаков. — Задачи данных моделей — поиск лица, выделение ключевых точек и предсказание, куда именно смотрит человек на мониторе. Первые две уже готовы, третью мы будем реализовывать в ближайшее время. На данный момент нет открытых подходящих датасетов, поэтому мы будем собирать данные для них самостоятельно.

Ранее команда под руководством Игоря Кулакова уже создала прототип нейросетевой системы, который находит и обрабатывает жесты рук с камеры. Также сейчас создаётся модель для обработки голосовых команд. Всё это также будет использоваться в айтрекере.

Как отметил Игорь Кулаков, в направлении айтрекинга проводилось не так много исследований, и существующие решения имеют относительно большие погрешности при работе.

— На данный момент лучший результат показывают системы, которые крепятся на голове с помощью шлема, — рассказал Игорь Кулаков. — Но даже у них достаточно большая погрешность — точность составляет примерно 0.5°–1° визуального угла, что на обычной дистанции, например, 60–70 см от экрана, соответствует 1–2 см или 30–50 пикселей. Нейросетевые айтрекеры «ошибаются» ещё больше — погрешности могут достигать нескольких градусов визуального угла, что на практике может означать отклонения на 5 см и больше от реальной точки взгляда. С учётом появления огромного инструментария для создания моделей машинного обучения, мы считаем, что можем сделать лучше.

Разработка студентов была представлена на всероссийском студенческом командном соревновании по программированию «Хакатон: грамотное решение» и заняла первое место в номинации «Искусственный интеллект».

Эту и другие новости читайте в официальном телеграм-канале Новгородского университета.